最近は、パソコンの中だけで動く「ローカルAI」に注目が集まっています。インターネットにつながなくても使えることや、自分の環境で試せることから、興味を持つ方も増えているように感じます。

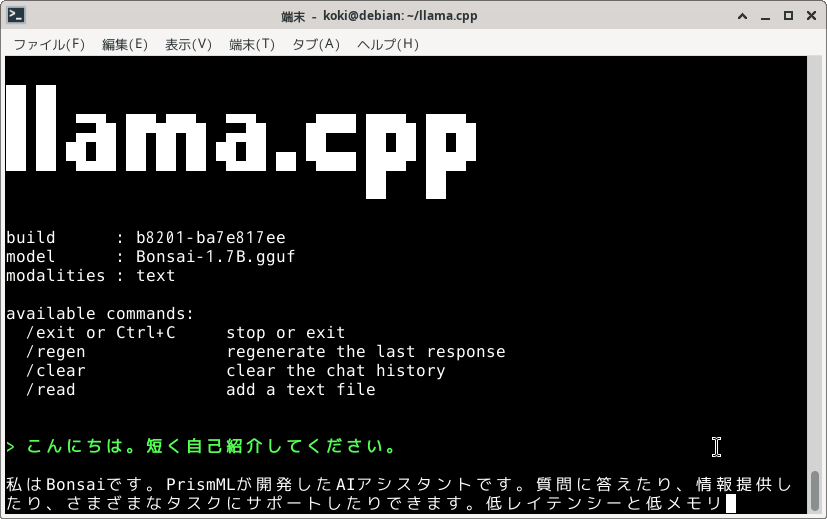

今回は、古いパソコンで、実際にローカルAIがどのくらい動くのかを試してみました。使ったのは Bonsai-1.7B という比較的軽量なモデルです。

結論から言うと、一応動きました。

ただし、速度・快適さ・実用性はかなり厳しいというのが正直な感想です。

今回試した環境

今回使ったパソコンの構成は次の通りです。

- CPU:Core i7(第4世代)

- メモリ:8GB

- OS:Debian

- GPU:なし

最近の高性能なパソコンではなく、グラフィックボードはありませんが、10年前なら結構ハイスペックな構成に近い環境です。「このくらいのPCでもAIは動くのだろうか」という目線で試しました。

なぜLM Studioではなく、別の方法を選んだのか

ローカルAIを試す方法としては、LM Studioのような使いやすいアプリもあります。ただ、今回の環境では、できるだけ軽い方法を選びたかったため、GUIではなく llama.cpp を使う形にしました。

見た目のわかりやすさよりも、まずはなるべく余計な負荷を減らして、本当に動くか確かめることを優先した形です。

実際に行った手順

大まかな流れは次の通りです。

1. 必要なものを入れる

sudo apt update

sudo apt install -y git cmake build-essential libopenblas-dev pkg-config python3-venvこのコマンドは、ローカルでAIを動かすための環境構築です。

具体的には、まず、GitHubからプログラムをダウンロードするための準備。

次に、そのプログラムを自分のパソコンで動く形に変換する(ビルドする)ための準備。

さらに、そのときに必要になる基本的な開発ツール一式。

そして、AIの計算を少しでも速くするための数値計算ライブラリ。

加えて、それらのライブラリを正しく見つけて使うための補助ツール。

最後に、Pythonの環境を安全に分けて使うための仕組み(仮想環境)も入れています。

まとめると、

「ダウンロード → ビルド → 実行 → Python環境」までを一通りできるようにする準備」

というイメージです。

2. llama.cpp を取得する

git clone https://github.com/PrismML-Eng/llama.cpp.git

cd llama.cppllama.cpp は、大規模言語モデルを手元のPCで動かすための実行エンジンです。

Bonsai本体 :AIの頭脳、モデルデータ

llama.cpp =:その頭脳を実際に動かすための土台

みたいなことです。なので、Bonsaiを入れる前にllama.cppを準備しておく必要があります。

llama.cppでできること

① CLIで直接動かす

👉 llama-cli で、ターミナルからそのまま質問できる

② ローカルサーバーとして動かす

👉 llama-server で、ブラウザや他のアプリから使える

③ GGUF形式のモデルを扱う

👉 GGUFという形式のAIモデルを読み込んで動かせる

3. ビルドする

cmake -B build -DGGML_BLAS=ON -DGGML_BLAS_VENDOR=OpenBLAS

cmake --build build -j24. Pythonの仮想環境を用意する

Debian本体のpythonに影響が出ないように、念のためpythonの仮想環境を作って作業を行います。

python3 -m venv .venv

source .venv/bin/activate

python -m pip install -U pip

python -m pip install "huggingface_hub[cli]"5. モデルをダウンロードする

mkdir -p models

hf download prism-ml/Bonsai-1.7B-gguf Bonsai-1.7B.gguf --local-dir models6. 実際に起動する

./build/bin/llama-cli \

-m models/Bonsai-1.7B.gguf \

-p "こんにちは" \

-n 24 \

-c 256-n と -c とは何か

ローカルAIを動かすときに、少しわかりにくいのが -n と -c です。今回はこの2つを小さめに設定して、できるだけ軽く動かしました。

-n とは

-n は、AIがどのくらいの長さまで答えるかを決める設定です。

数字が大きいほど長い文章を返しやすくなりますが、その分だけ時間もかかります。

-n 10… とても短い返答-n 24… 今回試した軽量設定-n 50… 少し説明できる長さ-n 100… 長めの返答になるが重くなりやすい

たとえば、-p "AIとは何ですか?" と聞いたとき、

-n 10 なら、

AIとは人工知能のことです。-n 50 なら、

AIとは人工知能のことで、人間のように学習や判断を行う技術です。

機械学習やディープラーニングなどが含まれます。というように、答えの長さが変わります。

-c とは

-c は、どのくらい前の文章まで覚えていられるかを決める設定です。

数字が大きいほど、長い会話や長文の指示を扱いやすくなりますが、その分だけ重くなります。

-c 128… とても短い文脈向け-c 256… 今回試した軽量設定-c 512… 少し余裕がある-c 1024以上 … 長めの文脈を扱えるが重くなりやすい

-c とは

-c は、AIがどのくらい前の文章まで覚えていられるかを決める設定です。

数字が大きいほど、長い指示や会話の流れを保ちやすくなりますが、その分だけ処理は重くなります。

たとえば、

- 最初に「100文字以内で答えてください」と指示する

- 次に「ローカルAIとは何ですか?」と質問する

という流れがあるとします。

-c が小さすぎると、最初の「100文字以内で」という指示をうまく保てず、長く答えてしまうことがあります。

反対に -c を大きくすると、前の指示も踏まえて答えやすくなります。

ただし、今回のような古めのPCでは、-c を大きくするとそのぶん動作が重くなりました。

今回の設定が小さい理由

今回の環境は非力なため重くなり、待ち時間も長くなりました。そのため、まずは

-n 24

-c 256という軽量設定で試しました。

つまり、

-n= どれだけ話させるか-c= どれだけ覚えさせるか

がそのまま処理の重さに結びつきます。

実際に使ってみた感想

今回の検証では、古めのPCでも一応ローカルAIを動かすことはできました。ただし、速度や快適さの面ではかなり厳しく、日常的に使うには難しいというのが正直な感想です。

ひとまず、私が人柱になっておきましたので、スペックが低いPCでは無理をせず、ブラウザで使える一般的な生成AIを素直に使った方がよさそうです。😅

とはいえ、今回のような環境でも「一応動いた」ことを考えると、技術の進化はやはり速いと感じます。モデルの軽量化や実行環境の改善が進めば、今は厳しい構成でも、今後はもう少し気軽に動かせるようになるかもしれません。

その意味では、今回の結果は「まだ早かった」というだけで、ローカルAIそのものに可能性がないという話ではないと思います。これから先、古いPCでももう少し実用的に動く時代が来るのか、引き続き楽しみに見ていきたいところです。

動作

一応動きました。

AIとしての返答は返ってきます。まったく起動しない、ということはありませんでした。

速度

かなり厳しいです。

軽めの設定にしても、反応は遅く感じました。気軽に会話するというより、「待ちながら試す」感覚に近いです。

快適さ

快適とは言えません、むしろしんどい(w

ブラウザで開く形も試しましたが、こちらはさらに重く感じました。見た目はわかりやすくても、今回の環境ではあまり向いていませんでした。

実用性

日常的に使うには厳しい印象です。

「とりあえず動くか試したい」という目的ならよいのですが、これを普段の作業にそのまま使うのは難しいと感じました。

なぜここまで重く感じたのか

理由はいくつかあります。

- GPUがなく、CPUだけで動かしている

- CPUが古めである

- メモリが8GBである

- 文脈を長く取ると負荷が大きくなる

- ブラウザ表示ではさらに重くなる

つまり、動くことと、快適に使えることは別ということがよくわかりました(w

今回の評価

| 項目 | 評価 |

|---|---|

| 動作 | 一応動く |

| 速度 | × |

| 快適さ | × |

| 実用性 | × |

まとめ

今回は、Core i7 第4世代・メモリ8GB・Debian という、少し古めのPCでローカルAIを試してみました。

結果として、Bonsai-1.7Bは一応動きました。

ただし、速度や使いやすさの面ではかなり厳しく、このまま常用するのは難しいというのが正直なところです。

それでも、こうした試行錯誤を通して、

- AIはどんな環境でどのくらい動くのか

- 軽量モデルとはいえ、実際にはどの程度の性能が必要なのか

- 見た目の便利さより、土台の性能が大切なこと

など、学べることは多くありました。

つくば高等学院では、こうした情報技術も、単に「流行っているもの」として見るのではなく、実際に試してみて、考えてみることを大切にしています。

これからも、身近な機材や環境で試せることを、少しずつ発信していければと思います。